洞察(Perception)

感知運算負責把原始感測資料轉為有意義的資訊,讓機器人可以理解周遭環境並進行決策。

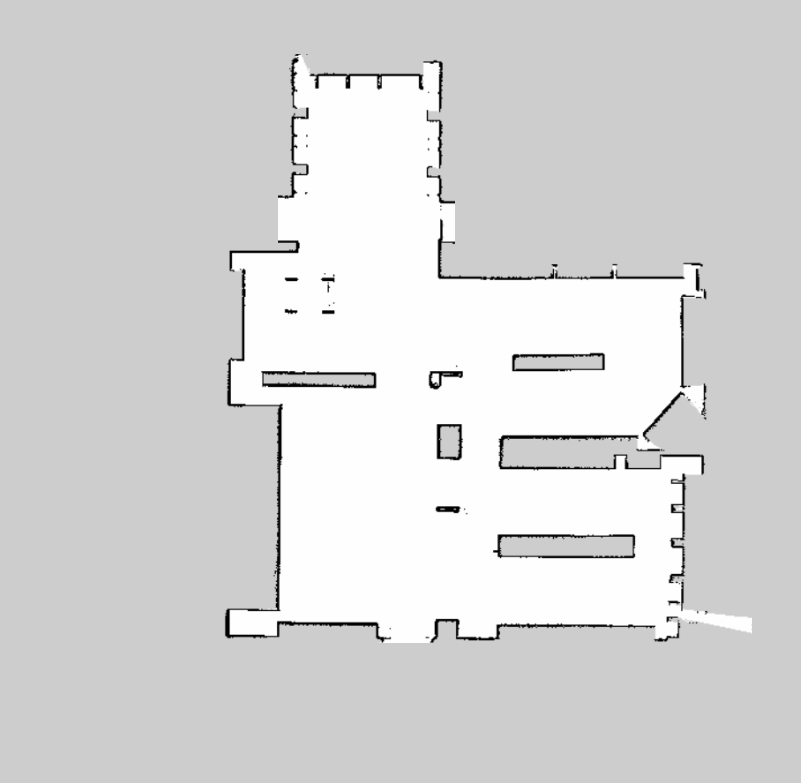

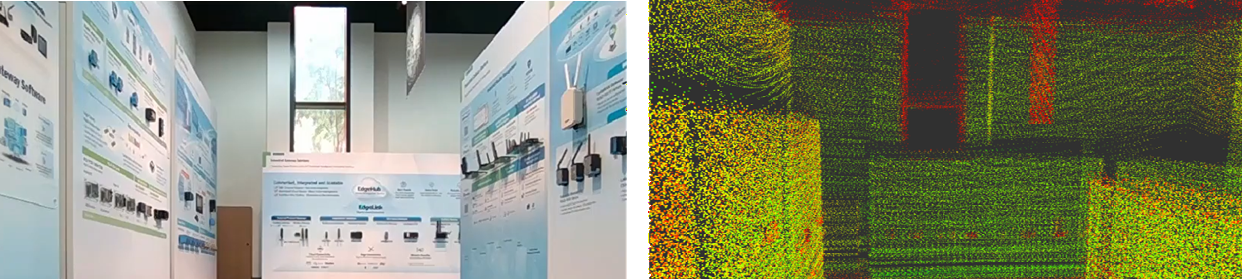

1. 建圖(Mapping)

- 目標: 邊移動邊建立環境地圖

- 輸入: LiDAR/相機資料

- 輸出:

- 2D 佔據格網圖

- 3D 點雲地圖

- 範例:

- 2D SLAM(例如 slam_toolbox)

- 3D SLAM(LiDAR / 視覺 SLAM)

- 2D SLAM(例如 slam_toolbox)

2. 定位(Localization)

- 目標: 推算機器人在環境中的位置與姿態

- 輸入: LiDAR/相機/IMU

- 輸出: 機器人姿態(x, y, z, roll, pitch, yaw)

- 常見方法:

- LiDAR 定位(NDT、AMCL)

- 視覺 SLAM(ORB-SLAM、Isaac ROS Visual SLAM)

- 感測融合(例如 IMU + LiDAR 的 EKF)

- ROS 2 Topic 範例:

/localization/pose

/tf

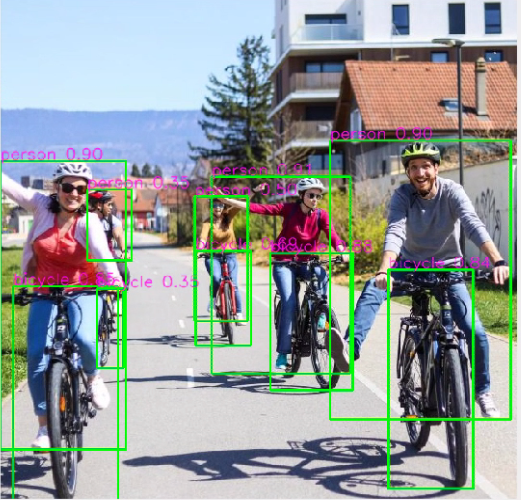

3. 物件偵測

-

目標: 找出並分類環境中的物件

-

輸入: 相機影像

-

輸出: Bounding box、類別標籤、信心值

-

範例:

- YOLO(如 Isaac ROS YOLOv8)可辨識人員、障礙物、棧板等

處理完的資訊會交給規畫(Planning)模組,產生具體行動。